Cet article est publié en partenariat avec le blog du CNAM.

Actuellement en plein essor, les technologies reposant sur

l’intelligence artificielle n’ont de fait que peu à voir avec

l’intelligence humaine. Leur développement impose de former les jeunes

et moins jeunes à la science algorithmique pour mieux les comprendre et

de garder à l’esprit que les machines et leurs calculs sont faillibles.

Parcourez la presse qu’elle soit

spécialisée

ou non, l’intelligence artificielle (IA) occupe le devant de la scène

médiatique. Depuis les années 2010, cette notion jusque-là

principalement visible dans les romans de science-fiction s’est

introduite dans notre quotidien via des technologies toujours plus

performantes. Mais pour comprendre ce phénomène, il convient de faire un

détour par son étymologie.

D’où vient le mot « intelligence » ? Il est emprunté au latin

intelligentia, « faculté de percevoir, compréhension, intelligence »,

lui-même dérivé de intellĕgĕre (« discerner, saisir, comprendre »),

composé du préfixe inter- (« entre ») et du verbe lĕgĕre (« cueillir,

choisir, lire »). Étymologiquement, l’intelligence consiste donc à faire

un choix. Même si la définition de l’intelligence est objet de nombreux

débats, on peut parler d’une activité volontaire et réfléchie qui

s’oppose à l’instinct.

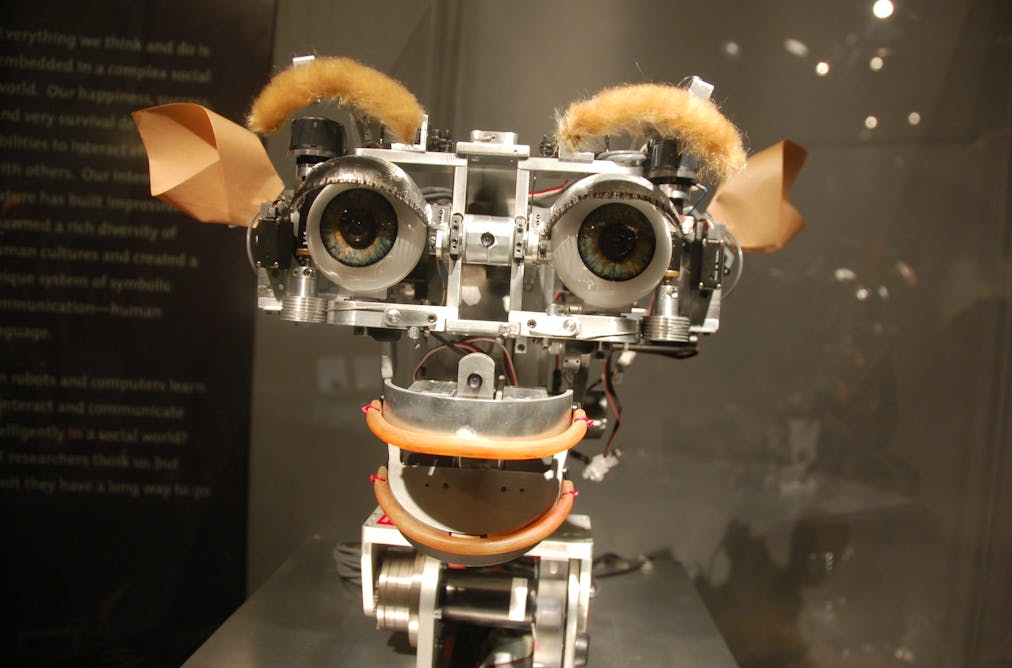

Ajouter l’adjectif « artificielle » après « intelligence » ne change

qu’assez peu la question. Chercher à concevoir des machines qui auront

un fonctionnement imitant une activité humaine est passionnant d’un

point de vue théorique ; ces technologies sont certes efficaces pour se

libérer d’une multitude de tâches du quotidien, mais parler avec un

chatbot

(un logiciel programmé pour simuler une conversation en langage

naturel) reste du même acabit qu’une conversation avec son chat. On voit

donc que les termes de voitures, téléphones ou montres intelligentes

constituent des non-sens. Ils montrent avant tout l’étendue de la

méconnaissance et des fantasmes (humains). Que dire, alors du

statut de citoyen accordé à un robot ?

Comprendre le fonctionnement des technologies de l’IA

Réfléchir à l’intelligence artificielle est donc important et ne doit pas se limiter à la manière de monétiser l’IA. Le récent

rapport Villani propose des pistes sur l’éthique ainsi que des éléments pour la gouvernance à l’heure d’un monde numérique. En ce sens, la

nouvelle formation d’ingénieur·e en alternance du Cnam en IA/big data

est aussi un élément important : pour faire des choix il faut

comprendre comment fonctionnent ces technologies et quelles en sont les

limites.

Si l’un des aspects majeurs de la révolution numérique est

l’accumulation de données, il faut garder à l’esprit que derrière toute

donnée, il y a une mesure, c’est-à-dire une chose mesurée et bien sûr,

des conventions sociales. L’accès aux données, l’archivage ou le

stockage, représentent un pan important de l’informatique. Sans données,

pas d’IA. On pourrait discuter longuement sur les types ou la qualité

des données, les questions techniques ou le lien entre savoir mesurer et

savoir comprendre… Là n’est pas notre propos : nous allons nous

concentrer sur le traitement de cette information, à la base de tout

choix.

L’IA permet de proposer des règles de décision au sein de cette masse d’informations.

Descartes rêvait d’une langue :

« établissant un ordre entre toutes les pensées qui peuvent entrer en

l’esprit humain, de même qu’il y en a un naturellement établi entre les

nombres. »

Leibniz, quant à lui imaginait que :

« cette langue serait merveilleuse (…) car alors raisonner et calculer sera la même chose ».

La réalité est (mal)heureusement plus compliquée. Le principe des

algorithmes, à la base de l’intelligence artificielle, est de chercher

des règles de calcul plus ou moins pertinente. Vouloir des algorithmes

transparents et accessibles n’a de sens que si l’on est capable de les

comprendre.

Il y a donc urgence à former les élèves et les étudiant·e·s à la

science algorithmique. À titre d’exemple, pour un·e mathématicien·e ou

un·e informaticien·e, le système d’admission

post-bac APB, fortement décrié pour ses limites, répond au nom d’

algorithme de Gale-Shapley

(on parle aussi d’algorithme des mariages stables) et est connu pour

des propriétés d’optimalité. Ceci ne signifie pas que l’on ne doive pas

en changer (par exemple, si l’on ne veut pas que les lycéens

hiérarchisent leurs choix) mais tout changement nécessite d’être

conscient des inconvénients auxquels on s’expose (par exemple ne pas

connaître les préférences des élèves).

Eviter que les humains ne deviennent de plus en plus stupides

De même, faire des choix implique de pouvoir faire des erreurs. Si

l’on apprend de ses erreurs (ainsi que des erreurs des autres), il est

fondamental de ne pas accorder une confiance aveugle aux algorithmes.

Qui ne s’est jamais retrouvé dans des bouchons en suivant trop

aveuglément un GPS ? La notion d’intelligence artificielle génère de

fait la notion de bêtise artificielle. L’idée de pouvoir justifier (au

moins en partie) un choix et donc de pouvoir le contester est au

fondement du concept d’intelligence.

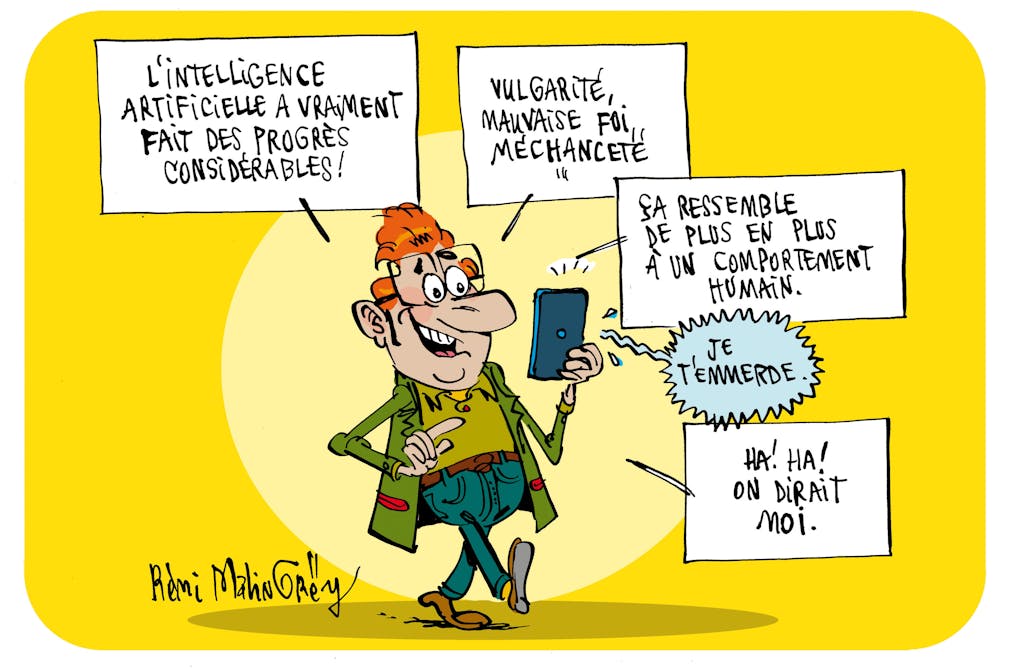

Le risque donc n’est pas de voir les machines devenir plus

« intelligentes » que les humains (mythe de la singularité), mais plutôt

que les humains deviennent plus en plus stupides. Il va nous falloir

nous adapter à une société numérique, et au lieu d’une intelligence

artificielle, privilégions une utilisation de l’IA qui nous aide à

prendre des décisions respectant nos valeurs fondamentales.